作者:程明,物理学博士。曾在《自然》《物理评论通讯》PRL 等世界顶尖学术杂志上发表过 10 多篇论文,被多本教科书,如宾大著名教授 Lubensky所著《凝聚态物理原理》以及诺贝尔奖获得者Kosterlitz教授在总结拓扑相变30年的文章中引用,程明博士的论文被认为是开拓性的工作。 程明博士曾在美国硅谷多家高科技公司工作,著有《留美专家谈电子商务》(广东人民出版社)。2000年,和 《有机分子的电子晶体学》Springer, 2012 (章节作者)。曾海归在武汉大学,南京大学任教和担任研究生指导老师。十万个为什么 3.0 丛书

***

虽然AI在模式识别和数据处理方面无与伦比,但真正的创新和直觉仍然是人类的领域。未来或许会有更多的跨领域合作,结合计算科学和人类的创意思维,共同推动科学和技术的进步 。。。

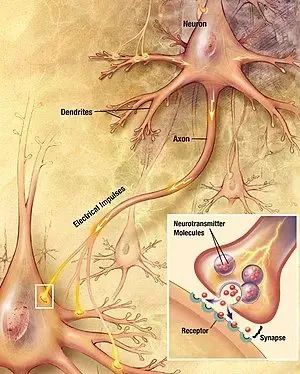

现有的人工神经网络是如何学习的

人工神经网络(Artificial Neural Networks, ANNs)是模仿人脑神经元结构和功能的一种计算模型,用于处理复杂的任务如图像识别、语音处理和自然语言理解。以下是人工神经网络目前的典型的学习方法。1. 数据准备

人工神经网络的学习始于大量的数据,这些数据用于训练网络。例如,训练一个手写数字识别的网络,我们需要成千上万的手写数字图像,每张图像对应一个数字标签(0到9)。

2. 网络结构

人工神经网络由多个层级组成,包括输入层、隐藏层和输出层。每一层由多个神经元(或节点)组成,这些节点通过权重连接,形成网络结构。通常来说,输入层接收数据,隐藏层处理数据,输出层生成结果

3. 前向传播

前向传播是神经网络中的关键步骤。输入数据在每一层中的节点间传递,每个节点通过权重和偏置的计算被激活。激活函数,像ReLU和sigmoid,就是用来处理这些计算结果的。ReLU (Rectified Linear Unit) 在正值时返回自身,负值时返回零。而sigmoid 函数则将数值映射到0和1之间。

激活函数就像是神经网络的“开关”,控制着信息的流动。4. 计算损失

损失函数是神经网络训练过程中至关重要的一步。均方误差 (MSE) 常用于回归问题,计算预测值和真实值之差的平方平均值,而交叉熵 (Cross-Entropy) 更适合分类问题,衡量预测概率分布与真实分布之间的差异。

这就像是网络的“指南针”,指引它朝着最小化误差的方向不断调整。感觉整个过程就像一个不断纠正自身的小学生。

5. 反向传播

反向传播确实通过计算每个权重对总损失的贡献,并使用梯度下降法来调整网络参数。这就像是在网络中“倒带”,确保每一个权重都被微调以减少误差。梯度下降法就像一个向导,引导网络找到能最小化误差的最佳路径,使得网络的预测越来越准确。

6. 学习迭代

通过多次迭代,模型能够更精确地捕捉数据中的特征,提高其预测能力。每次迭代都会调整网络的权重,使其误差更小。这就是深度学习模型训练的核心所在。7. 应用

训练后的网络通过在大量数据上学习,形成了对特征的深刻理解,从而能够对新数据做出准确的分类和预测。这种能力在许多实际应用中都至关重要,比如在医疗图像分析、语音识别和自然语言处理等领域。结论

人工神经网络通过模拟人脑的工作方式,实现了许多以前难以想象的技术突破。举个例子,它们在图像识别、语音识别和自然语言处理方面表现尤为出色。通过不断学习和调整,神经网络可以从复杂的数据中提取有用的信息,使其在各种应用场景中发挥巨大作用。问题:

人工神经网络的学习主要依靠统计和归纳方法,比如数据驱动、梯度下降和反向传播。这些方法强调从大量数据中提取模式和规律,与传统物理学中的理论和实验方法有很大的不同。虽然早期的神经网络借用了物理学中的一些概念(如能量函数),但现代AI的发展已经更多地依赖于计算科学和统计学工具。人工神经网络在本质上更多地依赖于已有数据进行归纳和模式识别,这些算法擅长从大量数据中提取规律和特征,但不具备人类的创意和直觉。创新往往需要跳出现有知识框架,产生新的想法和理论,这是人工神经网络目前难以实现的。

人工神经网络如何实现创新?

1. 多模态学习

将不同类型的数据(如图像、文字、音频等)进行结合,让神经网络在跨领域的数据中找出新的模式和联系,从而产生更综合性的解决方案。多模态学习可以增强网络的理解和推理能力,帮助其更好地处理复杂和多样化的信息。

2. 生成对抗网络(GANs)

GANs利用两个相互竞争的神经网络(生成器和判别器),生成器尝试创造新数据,判别器则尝试区分真实数据和生成数据。这种对抗机制可以激发网络产生更具创造性的输出。GANs已经在图像生成、艺术创作和数据增强等领域取得了显著成果。3. 进化算法

进化算法结合遗传算法或进化策略,让网络通过模拟自然进化过程自我改进和优化。通过选择、交叉和变异等过程,探索新的架构和学习方式。进化算法在优化复杂系统和解决高度非线性问题时表现优异。4. 强化学习

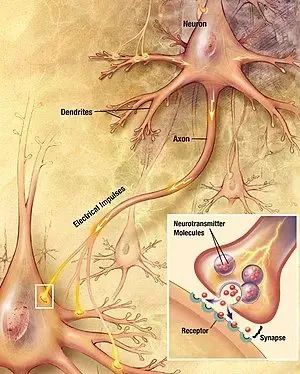

强化学习通过奖励和惩罚机制,鼓励神经网络自主探索新的策略和解决方案。这种方法已在游戏、机器人等领域取得了显著的成效。强化学习能让AI在未知环境中进行自主学习和决策,具备一定的创新能力。5. 神经形态计算

开发类脑计算芯片,模拟大脑的神经元和突触,以更接近人脑的方式处理信息。这种硬件创新有可能带来前所未有的学习能力和创新性。神经形态计算有望在处理复杂感知任务和提高能效方面取得突破。6. 合作学习

让多个神经网络互相合作和交流信息,模拟人类的团队协作。这样的设置可能会激发网络产生新的想法和解决方案。合作学习可以利用集体智能,解决单一网络难以解决的问题,提高整体系统的表现。应用层面与思想层面的创新

但是,这些图像生成和其他技术上的革新,更多是在应用层面的突破,而不是在思想或科学上的创新。这些技术利用已有的数据和算法进行优化和改进,但并未创造出全新的思想或概念。真正的思想创新通常需要超越现有知识的边界,进行深度的思考和探索,可能涉及哲学、社会科学等多个领域的融合。单纯使用计算机的算法无法实现真正的创新?

从根本上来说,我们认为,单纯使用计算机等的电子设备的算法,不可能实现真正的创新。因为这些结果的边界都是可以预见的。在运算中必须有真正的化学和物理过程。尽管计算机算法在数据处理和模式识别上表现出色,但它们的本质是基于既有数据和规则的推导,缺乏真正的创造性。将化学和物理过程引入计算中,可能带来更多未知的可能性和突破性发现。理论和实践支持

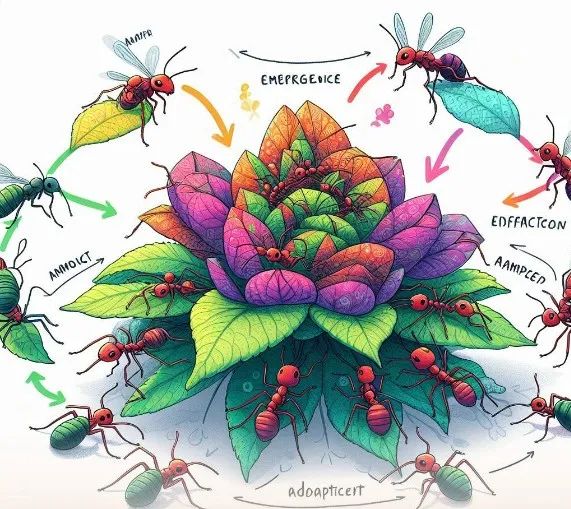

1. 自组织和复杂性理论

自组织理论指出,自然界中的许多创新和复杂性现象是通过物理和化学过程自发形成的。例如:生命的起源:早期地球上的化学反应通过自发组织形成复杂的有机分子,最终演变为生命形式。

细胞自我复制:细胞通过复杂的生化过程自我复制,实现生物体的生长和繁殖。

生态系统的演变:生态系统通过生物和非生物因素的相互作用,自发形成复杂的生态结构和功能。

这些现象表明,物理和化学过程在自然界的创新和复杂性形成中起着至关重要的作用。将这些原理应用于计算和人工智能中,可能会带来新的突破和发现。2. 量子计算

量子计算利用量子力学原理,解决传统计算机无法处理的复杂问题。量子叠加和纠缠现象是量子计算创新的基础,纯计算机算法无法模拟这种物理过程。就说明了纯计算机算法的局限性。 量子计算的成功展示了在某些情况下,只有结合物理过程才能突破现有算法的限制。这进一步证明了计算创新不仅仅依赖于纯粹的算法改进,还需要探索新的计算范式和技术手段。3. 人工智能与神经形态计算

经形态计算通过模拟大脑的神经元和突触的实际工作方式,并结合化学和电信号传递,试图更真实地再现人脑的复杂思维过程。这种方法不仅在硬件上尝试复制生物系统的功能,还在计算上引入了更多生物和物理的机制。这种结合有望带来深远的创新,因为它突破了传统计算机的限制,可能带来更高效、更智能的计算能力。正如量子计算展示了经典计算机的局限性一样,神经形态计算也表明,结合物理和化学过程的计算方法可能会产生前所未有的突破和可能性。

总结

诺贝尔物理奖颁给智能人工神经网络,可能正是为了强调这种跨学科的融合和未来潜力。虽然目前AI主要用于辅助人类完成繁重的计算任务,提供洞察和分析,但这已经释放了科学家的大量时间和精力,帮助他们更专注于创新和突破。虽然AI在模式识别和数据处理方面无与伦比,但真正的创新和直觉仍然是人类的领域。未来或许会有更多的跨领域合作,结合计算科学和人类的创意思维,共同推动科学和技术的进步。

发表评论